რა არის Robots.txt ფაილი? ყველაფერი რაც თქვენ გჭირდებათ რობოტების ფაილის დასაწერად, გაგზავნისთვის და გადახედვისთვის SEO-სთვის

ჩვენ დავწერეთ ყოვლისმომცველი სტატია როგორ პოულობენ, იკვლევენ და ინდექსირებენ თქვენს ვებსაიტებს საძიებო სისტემები. ამ პროცესში ფუნდამენტური ნაბიჯი არის robots.txt ფაილი, კარიბჭე საძიებო სისტემისთვის თქვენი საიტის დასათვალიერებლად. საძიებო სისტემის ოპტიმიზაციისას აუცილებელია იმის გაგება, თუ როგორ უნდა ავაშენოთ robots.txt ფაილი სწორად (SEO).

ეს მარტივი, მაგრამ ძლიერი ინსტრუმენტი ეხმარება ვებოსტატებს გააკონტროლონ როგორ ურთიერთქმედებენ საძიებო სისტემები მათ ვებსაიტებთან. robots.txt ფაილის გაგება და ეფექტური გამოყენება აუცილებელია ვებსაიტის ეფექტური ინდექსირებისა და საძიებო სისტემის შედეგებში ოპტიმალური ხილვადობის უზრუნველსაყოფად.

რა არის Robots.txt ფაილი?

robots.txt ფაილი არის ტექსტური ფაილი, რომელიც მდებარეობს ვებსაიტის root დირექტორიაში. მისი უპირველესი დანიშნულებაა საძიებო სისტემების მცოცავებზე ხელმძღვანელობა იმის შესახებ, თუ საიტის რომელი ნაწილები უნდა იყოს ან არ უნდა იყოს შენახული და ინდექსირებული. ფაილი იყენებს Robots Exclusion Protocol-ს (REP), სტანდარტული ვებსაიტები გამოიყენება ვებ მცოცავებთან და სხვა ვებ რობოტებთან კომუნიკაციისთვის.

REP არ არის ოფიციალური ინტერნეტ სტანდარტი, მაგრამ ფართოდ არის მიღებული და მხარდაჭერილი ძირითადი საძიებო სისტემების მიერ. მიღებულ სტანდარტთან ყველაზე ახლოს არის დოკუმენტაცია ძირითადი საძიებო სისტემებისგან, როგორიცაა Google, Bing და Yandex. დამატებითი ინფორმაციისთვის ეწვიეთ Google-ის Robots.txt სპეციფიკაციები რეკომენდირებულია.

რატომ არის Robots.txt კრიტიკული SEO-სთვის?

- კონტროლირებადი ცოცხალი: Robots.txt ვებსაიტების მფლობელებს საშუალებას აძლევს, ხელი შეუშალონ საძიებო სისტემებს მათი საიტის კონკრეტულ მონაკვეთებზე წვდომაში. ეს განსაკუთრებით სასარგებლოა დუბლიკატი კონტენტის, პირადი ტერიტორიების ან სენსიტიური ინფორმაციის მქონე სექციების გამორიცხვისთვის.

- Crawl-ის ოპტიმიზებული ბიუჯეტი: საძიებო სისტემები გამოყოფენ crawl-ის ბიუჯეტს თითოეული ვებსაიტისთვის, იმ გვერდების რაოდენობას, რომლებსაც საძიებო სისტემის ბოტი ათვალიერებს საიტზე. შეუსაბამო ან ნაკლებად მნიშვნელოვანი სექციების აკრძალვით, robots.txt ეხმარება ამ crawl-ის ბიუჯეტის ოპტიმიზაციას, რაც უზრუნველყოფს უფრო მნიშვნელოვანი გვერდების შენახვას და ინდექსირებას.

- გაუმჯობესებული ვებსაიტის ჩატვირთვის დრო: ბოტების უმნიშვნელო რესურსებზე წვდომის თავიდან აცილებით, robots.txt-ს შეუძლია შეამციროს სერვერის დატვირთვა, პოტენციურად გააუმჯობესოს საიტის ჩატვირთვის დრო, რაც მნიშვნელოვანი ფაქტორია SEO-ში.

- არასაჯარო გვერდების ინდექსირების პრევენცია: ის ხელს უწყობს არასაჯარო ტერიტორიების (როგორიცაა დადგმის საიტები ან განვითარების ზონები) ინდექსირებას და ძიების შედეგებში გამოჩენას.

Robots.txt ძირითადი ბრძანებები და მათი გამოყენება

- დაშვება: ეს დირექტივა გამოიყენება იმის დასაზუსტებლად, თუ რომელ გვერდებზე ან სექციებზე უნდა იყოს წვდომა მცოცავებმა. მაგალითად, თუ ვებსაიტს აქვს SEO-სთვის განსაკუთრებით შესაბამისი განყოფილება, ბრძანება "ნებადართულია" უზრუნველყოფს მის დაცინვას.

Allow: /public/- აკრძალვა: „დაშვების“ საპირისპიროდ, ეს ბრძანება ავალებს საძიებო სისტემის ბოტებს, არ დაათვალიერონ ვებსაიტის გარკვეული ნაწილები. ეს სასარგებლოა SEO მნიშვნელობის გარეშე გვერდებისთვის, როგორიცაა შესვლის გვერდები ან სკრიპტის ფაილები.

Disallow: /private/- Wildcards: wildcards გამოიყენება შაბლონების შესატყვისად. ვარსკვლავი (*) წარმოადგენს სიმბოლოების ნებისმიერ თანმიმდევრობას, ხოლო დოლარის ნიშანი ($) ნიშნავს URL-ის დასასრულს. ისინი სასარგებლოა URL-ების ფართო სპექტრის დასაზუსტებლად.

Disallow: /*.pdf$- საიტის რუქები: robots.txt-ში საიტის რუქის მდებარეობის ჩართვა საძიებო სისტემებს ეხმარება საიტის ყველა მნიშვნელოვანი გვერდის პოვნაში და დათვალიერებაში. ეს გადამწყვეტია SEO-სთვის, რადგან ის ხელს უწყობს საიტის უფრო სწრაფ და სრულ ინდექსირებას.

Sitemap: https://martech.zone/sitemap_index.xmlRobots.txt დამატებითი ბრძანებები და მათი გამოყენება

- მომხმარებლის აგენტი: მიუთითეთ რომელ მცოცავზე ვრცელდება ეს წესი. 'მომხმარებლის აგენტი: *' ვრცელდება წესზე ყველა მცოცავისთვის. მაგალითი:

User-agent: Googlebot- Noindex: მიუხედავად იმისა, რომ არ არის სტანდარტული robots.txt პროტოკოლის ნაწილი, ზოგიერთ საძიებო სისტემას ესმის ა noindex დირექტივა robots.txt-ში, როგორც ინსტრუქცია, რომ არ მოხდეს მითითებული URL-ის ინდექსირება.

Noindex: /non-public-page/- სეირნობის დაყოვნება: ეს ბრძანება სთხოვს მცოცავებს, დაელოდონ გარკვეული დრო თქვენს სერვერზე დარტყმებს შორის, რაც სასარგებლოა სერვერის დატვირთვის პრობლემების მქონე საიტებისთვის.

Crawl-delay: 10როგორ შეამოწმოთ თქვენი Robots.txt ფაილი

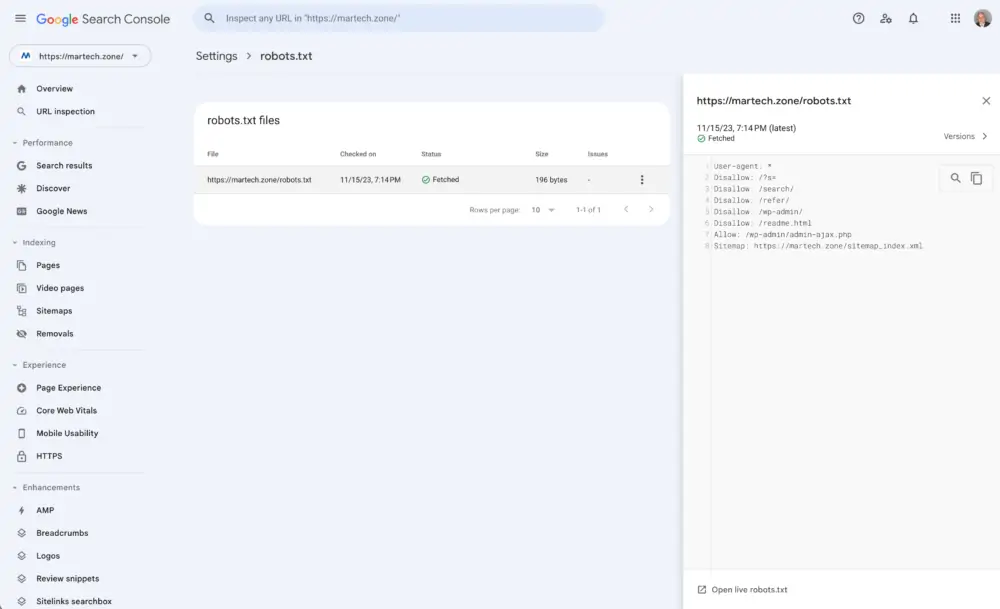

მიუხედავად იმისა, რომ დაკრძალულია Google ძებნა Console, საძიებო კონსოლი გთავაზობთ robots.txt ფაილის ტესტერს.

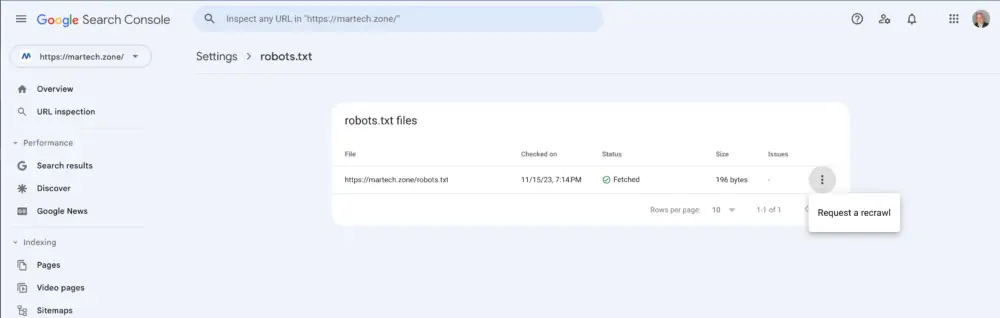

თქვენ ასევე შეგიძლიათ ხელახლა გაგზავნოთ თქვენი Robots.txt ფაილი მარჯვნივ სამ წერტილზე დაწკაპუნებით და არჩევით მოითხოვეთ ხელახალი სეკრეცია.

შეამოწმეთ ან ხელახლა გაგზავნეთ თქვენი Robots.txt ფაილი

შეიძლება თუ არა Robots.txt ფაილის გამოყენება AI ბოტების სამართავად?

robots.txt ფაილი შეიძლება გამოყენებულ იქნას თუ არა AI ბოტებს, მათ შორის ვებ მცოცავებსა და სხვა ავტომატიზირებულ ბოტებს, შეუძლიათ თქვენი საიტის შინაარსის დაცინვა ან გამოყენება. ფაილი ხელმძღვანელობს ამ ბოტებს და მიუთითებს ვებსაიტის რომელ ნაწილებზე მათ აქვთ წვდომა დაშვებული ან აკრძალული. robots.txt-ის ეფექტურობა, რომელიც აკონტროლებს AI ბოტების ქცევას, დამოკიდებულია რამდენიმე ფაქტორზე:

- პროტოკოლის დაცვა: ყველაზე ცნობილი საძიებო სისტემების მცოცავი და მრავალი სხვა AI ბოტი პატივს სცემს დადგენილ წესებს

robots.txt. თუმცა, მნიშვნელოვანია აღინიშნოს, რომ ფაილი უფრო მოთხოვნადია, ვიდრე აღსასრულებელი შეზღუდვა. ბოტებს შეუძლიათ იგნორირება გაუკეთონ ამ მოთხოვნებს, განსაკუთრებით ნაკლებად სკრუპულოზური ორგანიზაციების მიერ. - ინსტრუქციის სპეციფიკა: თქვენ შეგიძლიათ მიუთითოთ სხვადასხვა ინსტრუქციები სხვადასხვა ბოტებისთვის. მაგალითად, თქვენ შეიძლება ნება დართოთ კონკრეტულ AI ბოტებს, დაათვალიერონ თქვენი საიტი, ხოლო სხვებს არ დაუშვებთ. ეს კეთდება გამოყენებით

User-agentდირექტივაშიrobots.txtფაილის მაგალითი ზემოთ. Მაგალითად,User-agent: Googlebotდააკონკრეტებდა ინსტრუქციებს Google-ის მცოცავისთვის, მაშინ როცაUser-agent: *ვრცელდება ყველა ბოტზე. - შეზღუდვები: მიუხედავად იმისა,

robots.txtშეუძლია ხელი შეუშალოს ბოტებს მითითებული შინაარსის ცოცვისგან; ის არ მალავს მათ შინაარსს, თუ მათ უკვე იციან URL. გარდა ამისა, ის არ იძლევა რაიმე საშუალებებს, რათა შეზღუდოს კონტენტის გამოყენება მას შემდეგ, რაც ის ნახულობს. თუ საჭიროა კონტენტის დაცვა ან გამოყენების სპეციფიკური შეზღუდვები, შეიძლება საჭირო გახდეს სხვა მეთოდები, როგორიცაა პაროლით დაცვა ან უფრო დახვეწილი წვდომის კონტროლის მექანიზმები. - ბოტების ტიპები: ყველა AI ბოტი არ არის დაკავშირებული საძიებო სისტემებთან. სხვადასხვა ბოტები გამოიყენება სხვადასხვა მიზნებისთვის (მაგ. მონაცემთა აგრეგაცია, ანალიტიკა, შინაარსის სკრაპი). robots.txt ფაილი ასევე შეიძლება გამოყენებულ იქნას ამ სხვადასხვა ტიპის ბოტების წვდომის სამართავად, თუ ისინი იცავენ REP-ს.

ის robots.txt ფაილი შეიძლება იყოს ეფექტური ინსტრუმენტი თქვენი პრეფერენციების სიგნალიზაციისთვის AI ბოტების მიერ საიტის შინაარსის სეირნობისა და გამოყენების შესახებ. თუმცა, მისი შესაძლებლობები შემოიფარგლება მითითებების მიწოდებით და არა მკაცრი წვდომის კონტროლის განხორციელებით და მისი ეფექტურობა დამოკიდებულია ბოტების შესაბამისობაზე Robots Exclusion Protocol-თან.

robots.txt ფაილი არის პატარა, მაგრამ ძლიერი ინსტრუმენტი SEO არსენალში. მას შეუძლია მნიშვნელოვანი გავლენა მოახდინოს ვებსაიტის ხილვადობასა და საძიებო სისტემის მუშაობაზე, თუ სწორად გამოიყენება. ვებმასტერებს შეუძლიათ აკონტროლონ, თუ რომელი საიტის ნაწილები იწერება და ინდექსირებულია, ხაზგასმულია მათი ყველაზე ღირებული შინაარსი, რაც აუმჯობესებს მათ SEO ძალისხმევას და ვებსაიტის მუშაობას.